- Matrice (mathématiques)

-

Pour les articles homonymes, voir Matrice.

Pour les articles homonymes, voir Matrice.En mathématiques, les matrices sont des tableaux de nombres qui servent à interpréter en termes calculatoires et donc opérationnels les résultats théoriques de l'algèbre linéaire et même de l'algèbre bilinéaire. Toutes les disciplines étudiant des phénomènes linéaires utilisent les matrices. Quant aux phénomènes non linéaires, on en donne souvent des approximations linéaires, comme en optique géométrique avec les approximations de Gauss.

L'article Théorie des matrices présente des applications pratiques des matrices.Définitions

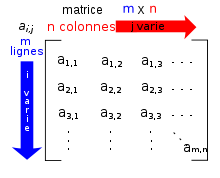

Une matrice à m lignes et n colonnes est un tableau rectangulaire de mn nombres, rangés ligne par ligne. Il y a m lignes, et dans chaque ligne n nombres.

Passons maintenant à la définition formelle. Soient R un ensemble et (m,n) un couple d'entiers positifs. Le plus souvent, l'ensemble R est muni d'une structure de corps commutatif mais on utilise aussi fréquemment des matrices à coefficients dans un anneau.

On appelle matrice à coefficients dans R, de dimension (ou taille) (m, n) (c'est-à-dire à m lignes et n colonnes), une famille (ai,j) d'éléments de R indexée par le produit cartésien des ensembles de nombres entiers {1, … , m} et {1, … , n}.

La matrice A pourra être notée par

ou plus simplement (ai,j) si le contexte s'y prête.

On représente généralement une matrice sous la forme d'un tableau rectangulaire. Par exemple, est représentée ci-dessous une matrice A, à coefficients entiers, et de dimension (3,4) :

Dans cette représentation, le premier coefficient de la dimension est le nombre de lignes, et le deuxième, le nombre de colonnes du tableau. Une matrice pour laquelle le nombre m de lignes est égal au nombre n de colonnes sera dite matrice carrée de taille (ou d’ordre) n. Une matrice ne comportant qu'une seule ligne et n colonnes est appelée matrice ligne de taille n. Une matrice comportant m lignes et une seule colonne est appelée matrice colonne de taille m.

Pour repérer un coefficient d'une matrice, on indique son indice de ligne puis son indice de colonne, les lignes se comptant du haut vers le bas et les colonnes de la gauche vers la droite. Par exemple, on notera ai,j, les coefficients de la matrice A, i compris entre 1 et 3 désignant le numéro de la ligne sur laquelle figure le coefficient envisagé, et j compris entre 1 et 4 désignant son numéro de colonne ; ainsi a2,4=7.

La disposition générale des coefficients d'une matrice A de taille (m,n) est donc la suivante

Les coefficients ai,j avec i = j sont dits diagonaux, ceux avec

sont dits extradiagonaux.

sont dits extradiagonaux.Une sous-matrice de A est une matrice obtenue en sélectionnant une partie

de ses lignes et une partie

de ses lignes et une partie  de ses colonnes ; on la note AI,J. On dit qu'une sous-matrice est principale si I = J dans la définition précédente. La diagonale de A est le vecteur

de ses colonnes ; on la note AI,J. On dit qu'une sous-matrice est principale si I = J dans la définition précédente. La diagonale de A est le vecteuroù p: = min(m,n).

Pour effectuer certaines opérations, il peut être utile de travailler sur le système des lignes ou des colonnes d'une matrice. On pourra alors l'écrire sous une des formes suivantes

ou

ou  .

.

L'ensemble des matrices à coefficients dans R possédant m lignes et n colonnes est noté Mm,n(R) (ou parfois M(m,n,R)).

Lorsque m=n on note plus simplement Mn(R).

Soit

, on appelle matrice transposée de A la matrice

, on appelle matrice transposée de A la matrice  . Remarquons que

. Remarquons que  .

.Par exemple, avec la matrice A des exemples précédents, on a

Espaces de matrices

On suppose maintenant que R est muni d'une structure d'anneau ; les éléments de R seront appelés scalaires, par opposition aux matrices dont nous allons voir qu'elles peuvent être considérées comme des vecteurs.

Addition et multiplication par un scalaire

On définit sur Mm,n(R) une loi de composition interne provenant de l'addition des scalaires :

- (ai,j) + (bi,j) = (ci,j), où ci,j = ai,j + bi,j.

On ne peut additionner que deux matrices de même taille.

- Exemple :

Pour chaque valeur du couple (m,n), l'espace Mm,n(R) devient alors un groupe abélien, d'élément neutre la matrice nulle, celle dont tous les coefficients valent 0.

On définit aussi une opération à gauche de R sur chaque espace Mm,n(R)en associant, à chaque scalaire λ dans R et à chaque matrice (ai,j) à coefficients dans R, la matrice λ(ai,j) = (λai,j) obtenue en effectuant la multiplication, dans R, de tous les coefficients de la matrice initiale par λ : c'est la multiplication par un scalaire.

En reprenant toujours la matrice A du premier exemple :

Les espaces Mm,n(R) ainsi obtenus ont donc une structure de R-module à gauche, et plus particulièrement de R-espace vectoriel, si R est un corps commutatif.

Base canonique de l'espace des matrices

Le R-module Mm,n(R) est libre de rang mn,, c'est-à-dire qu'il possède une base de mn éléments : il suffit de considérer la base canonique

. La matrice Ei,j est celle dont tous les coefficients sont nuls sauf celui d'indice (i,j), qui vaut 1.

. La matrice Ei,j est celle dont tous les coefficients sont nuls sauf celui d'indice (i,j), qui vaut 1.Les coordonnées dans la base canonique d'une matrice A sont ses coefficients :

- Exemple :

Produit matriciel

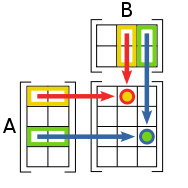

Article détaillé : Produit matriciel.On commence par définir le produit d'une matrice ligne par une matrice colonne[1]. Soit n un nombre entier, L une matrice ligne, xi ses coefficients, C une matrice colonne, yi ses coefficients. On les suppose toutes deux de taille n. On définit alors le produit, considéré comme un scalaire ou une matrice de dimension (1,1) :

On remarque la condition de compatibilité sur les tailles des matrices (égalité du nombre de colonnes de la première avec le nombre de lignes de la deuxième). On définit maintenant plus généralement un produit entre deux matrices, la première, (xi,j) dans Mm,n(R), la deuxième, (yi,j) dans Mn,p(R), toujours avec une condition de compatibilité sur les tailles (et l'ordre des facteurs de la multiplication ne peut en général pas être changé). Le résultat obtenu est une matrice de Mm,p(R), dont les coefficients (zi,j) sont obtenus par :

À la lumière de l'exemple de la multiplication d'une matrice ligne par une matrice colonne, on peut reformuler cette définition en disant que ce coefficient est égal au produit de la ligne i de la première matrice par la colonne j de la deuxième, ce qui s'écrit de la manière suivante, si les Li sont les lignes de la première matrice, et les Cj les colonnes de la deuxième, le produit est :

.

.Pour calculer en pratique un produit, il est nécessaire de visualiser l'opération. On considère le coefficient c1,2 de la matrice produit C=AB si A est une matrice de type (4, 2), et B est une matrice de type (2, 3).

Le produit matriciel est associatif, distributif à droite et à gauche par rapport à l'addition matricielle. En revanche, même si les dimensions permettent de donner un sens à la question, même si l'anneau des scalaires est commutatif, un produit de matrices ne commute en général pas : AB n'est pas égal à BA, par exemple :

Remarque : le produit de deux matrices non nulles peut être nul, comme l'exemple au-dessus.

Ce contre-exemple prouve même que les matrices AB et BA ne sont pas toujours semblables. Il arrive même, selon les tailles respectives des matrices A et B, que l'un des deux produits existe et pas l'autre.

Lorsque l'anneau des scalaires est commutatif, la transposition et le produit matriciel sont compatibles au sens suivant :

Matrice identité et inverse d'une matrice

Article détaillé : Matrice inversible.Pour chaque nombre entier n, on note In la matrice carrée de taille n dont les coefficients diagonaux sont égaux à 1 et dont les autres coefficients sont nuls ; elle est appelée matrice identité de taille n.

où δi,j désigne le symbole de Kronecker.

Sous réserve de compatibilité des tailles, les matrices In sont neutres à droite et à gauche pour la multiplication.

Soit A une matrice de dimension (m,n). On dit que A est inversible à droite (respectivement à gauche) s'il existe une matrice B de taille (n,m) telle que AB = Im (respectivement BA = In). Pour une matrice carrée à coefficients dans un anneau commutatif, être inversible à droite et à gauche sont deux propriétés équivalentes. Une matrice les vérifiant sera dite inversible, sans plus de précision. Une matrice carrée est inversible si et seulement si son déterminant est inversible dans R (ce qui, si R est un corps, équivaut à ce que ce déterminant soit non nul). Le sous-ensemble de Mn(R) constitué des matrices inversibles possède une structure de groupe pour le produit matriciel, est appelé groupe linéaire et noté GLn(R).

Algèbre des matrices carrées

Lorsque l'anneau R est commutatif, l'ensemble Mn(R) des matrices carrées de taille n est donc muni d'une structure de R-algèbre associative et unitaire avec l'addition matricielle, le produit par un scalaire et le produit matriciel.

On appelle matrice scalaire une matrice de la forme λIn où λ est un élément de l'anneau R.

Ces matrices s'appellent matrices scalaires car elles se comportent comme des scalaires, vis-à-vis de la multiplication :

Lorsque R est commutatif, ou à défaut, lorsque λ est central dans R, c'est-à-dire lorsque λ commute avec tous les éléments de R, on a en outre :

Réciproquement, toute matrice B de Mn(R) telle que

est une matrice scalaire λIn où λ est central dans R (ceci se démontre en prenant pour A les matrices de la base canonique).

est une matrice scalaire λIn où λ est central dans R (ceci se démontre en prenant pour A les matrices de la base canonique).Une matrice de la forme :

sera dite matrice diagonale.

Outre le déterminant, une autre fonction à noter est la trace. Toutes deux apparaissent dans un objet plus général, le polynôme caractéristique, qui à son tour permet d'obtenir certaines caractérisations des matrices diagonalisables (c'est-à-dire semblables à une matrice diagonale), ou de la trigonalisation.

Actions du groupe linéaire

Il existe plusieurs manières de faire agir le groupe linéaire GLn(R) sur les espaces de matrices, notamment :

- action par multiplication à gauche de GLm(R) sur Mm,n(R), qui à P et A, associe PA,

- action (à droite) par multiplication à droite de GLn(R) sur Mm,n(R), qui à

et

et  , associe AQ − 1,

, associe AQ − 1, - action par conjugaison de GLn(R) sur Mn(R), qui à

et

et  , associe PAP − 1.

, associe PAP − 1.

On décrit maintenant les résultats classiques sur ces actions, lorsque les scalaires forment un corps commutatif. Les deux premières actions sont souvent considérées simultanément ; on s'intéresse donc à la question : deux matrices A et B de dimension (m,n) étant données, existe-t-il des matrices

et

et  telles que A = PBQ − 1 ? Si tel est le cas, les deux matrices A et B sont dites équivalentes. Le résultat principal est que deux matrices sont équivalentes si et seulement si elles ont même rang, ce qui s'exprime encore en disant que le rang est un invariant complet pour les doubles classes définies par les deux actions de multiplication à gauche et à droite. Par ailleurs, une matrice étant donnée, on peut trouver d'autres matrices privilégiées (les matrices échelonnées) dans la même orbite pour une de ces actions par la méthode du pivot de Gauss.

telles que A = PBQ − 1 ? Si tel est le cas, les deux matrices A et B sont dites équivalentes. Le résultat principal est que deux matrices sont équivalentes si et seulement si elles ont même rang, ce qui s'exprime encore en disant que le rang est un invariant complet pour les doubles classes définies par les deux actions de multiplication à gauche et à droite. Par ailleurs, une matrice étant donnée, on peut trouver d'autres matrices privilégiées (les matrices échelonnées) dans la même orbite pour une de ces actions par la méthode du pivot de Gauss.Pour l'action par conjugaison, deux matrices carrées A et B de taille n dans la même orbite admettent une relation de la forme A = PBP − 1, pour une certaine matrice P inversible de taille n ; deux telles matrices sont dites semblables. La description d'un système complet d'invariants est plus délicate. On appelle ces invariants les invariants de similitude. D'un point de vue algorithmique, la réduction d'une matrice quelconque à une matrice sous une forme privilégiée se fait par un algorithme inspiré de celui du pivot de Gauss, voir théorème des facteurs invariants.

Interprétations linéaires

Un intérêt principal des matrices est qu'elles permettent d'écrire commodément les opérations habituelles de l'algèbre linéaire, avec une certaine canonicité.

Coordonnées

Le premier point est de remarquer que le R-module Rn s'identifie canoniquement à l'espace de matrices colonne Mn,1(R) : si ei est le n-uplet de Rn dont tous les coefficients sont nuls, sauf le i-ème qui vaut 1, on lui associe la i-ème matrice colonne Ei,1 de la base canonique de Mn,1(R) (celle dont tous les coefficients sont nuls sauf le i-ème qui vaut 1), et on étend l'identification par linéarité ; la matrice associée à chaque n-uplet sera appelée matrice coordonnée canonique.

D'autres identifications sont cependant possibles ; lorsqu'on peut parler de base (si l'anneau des scalaires est un corps, ou est principal, par exemple), on peut associer les matrices colonnes élémentaires à n'importe quelle base de l'espace Rn (ou plus généralement d'un R-module libre), puis à nouveau étendre par linéarité ; les matrices associées seront appelées matrices coordonnées dans la base envisagée.

On peut juxtaposer les matrices coordonnées, dans une base fixée, de plusieurs n-uplets. On obtient ainsi la matrice coordonnée d'une famille de vecteurs. Le rang de la matrice est alors défini comme la dimension de la famille de ces vecteurs. En particulier la matrice d'une base dans une autre base est appelée matrice de passage entre ces deux bases, ou matrice de changement de base. Si X et X' sont les matrices coordonnées du même vecteur dans deux bases B et C, et que P est la matrice de la base C dans la base B, on a la relation (une matrice de passage est toujours inversible) :

Applications linéaires

Soient E et F deux R-modules (à gauche) libres de dimensions finies. Soient B=(e1,...,ep) une base de E et C=(f1,...,fn) une base de F. Soit enfin φ une application linéaire de E dans F.

On appelle matrice de φ dans le couple de bases (B,C) la matrice :

L'application de L(E,F) dans Mn,p(R) qui à φ associe la matrice

L'application de L(E,F) dans Mn,p(R) qui à φ associe la matrice  est un isomorphisme.

est un isomorphisme.Soit x un vecteur de E. Notons y=φ(x),

,

,  et

et  . Lorsque l'anneau R est commutatif (ou si l'on travaille avec des modules à droite), ces matrices sont reliées par : Y = MX, autrement dit :

. Lorsque l'anneau R est commutatif (ou si l'on travaille avec des modules à droite), ces matrices sont reliées par : Y = MX, autrement dit :

,

Cette formule devient

pour des modules à gauche sur un anneau non commutatif.

Si ψ est une deuxième application linéaire, de F dans un troisième module G de base D, alors, relativement aux bases B, C, D, la matrice de la composée ψ∘φ est égale au produit des matrices de ψ et φ. Plus précisément :

En effet, pour tout vecteur x de E, en notant y=φ(x), z=ψ(y) et X, Y, Z les coordonnées respectives de ces trois vecteurs dans les bases B, C, D, on a Z=mat(C,D)ψ.Y=mat(C,D)ψ.mat(B,C)φ.X.

L'application

du R-module Mp,1(R) dans le R-module Mn,1(R) est linéaire et sa matrice dans les bases canoniques est M. C'est un point clef du lien entre algèbre linéaire et matrices.

du R-module Mp,1(R) dans le R-module Mn,1(R) est linéaire et sa matrice dans les bases canoniques est M. C'est un point clef du lien entre algèbre linéaire et matrices.En conséquence, il arrive souvent que l'on l'identifie avec l'application linéaire ci-dessus. On parlera alors de noyau de la matrice, d'espaces propres de la matrice, d'image de la matrice, etc.

Si E et F sont deux R-modules, B et B' deux bases de E, de cardinal p, et C et C' deux bases de F de cardinal n,

la matrice de passage de B vers B' et Q la matrice de passage de C vers C' , alors les deux matrices M et M' d'une même application linéaire φ de E dans F, dans les couples de bases (B,C) et (B',C') sont liées par la relation :

la matrice de passage de B vers B' et Q la matrice de passage de C vers C' , alors les deux matrices M et M' d'une même application linéaire φ de E dans F, dans les couples de bases (B,C) et (B',C') sont liées par la relation :On constate ainsi que deux matrices équivalentes sont deux matrices qui représentent la même application linéaire dans des bases différentes.

En particulier, dans le cas d'un endomorphisme, si on impose B= B' et C=C' , les formules précédentes se simplifient :

On constate ainsi que deux matrices semblables sont deux matrices qui représentent le même endomorphisme dans des bases différentes.

Systèmes d'équations linéaires

Article détaillé : Système d'équations linéaires.En général, un système de m équations linéaires à n inconnues peut être écrit sous la forme suivante :

Où x1,...,xn sont les inconnues et les nombres ai,j sont les coefficients du système.

Ce système peut s'écrire sous la forme matricielle :

- Ax = b

avec :

la théorie de la résolution des systèmes utilise les invariants liés à la matrice A (appelée matrice du système), par exemple son rang, et, dans le cas où A est inversible, son déterminant (voir l'article règle de Cramer).

Interprétations bilinéaires

Dans ce paragraphe, l'anneau R des scalaires sera supposé commutatif. Dans la plupart des applications, ce sera un corps commutatif.

Le cas non commutatif existe aussi mais il faut prendre quelques précautions et les notations deviennent trop lourdes pour cet article.

Matrice d'une forme bilinéaire

Soient E un R-module libre et B=(e1,...,en) une base de E.

Soit

une forme bilinéaire. On définit la matrice de f dans la base B par la formule suivante :

une forme bilinéaire. On définit la matrice de f dans la base B par la formule suivante :Dans le cas particulier où

et f est un produit scalaire, cette matrice est appelée matrice de Gram.

et f est un produit scalaire, cette matrice est appelée matrice de Gram.La matrice

est symétrique (respectivement antisymétrique) si et seulement si la forme bilinéaire f est symétrique (respectivement antisymétrique).

est symétrique (respectivement antisymétrique) si et seulement si la forme bilinéaire f est symétrique (respectivement antisymétrique).Soient x et y deux vecteurs de E. Notons X et Y leurs coordonnées dans la base B et

. On a alors la formule :

. On a alors la formule :  .

.Deux formes bilinéaires sont égales si et seulement si elles ont la même matrice dans une base donnée.

Matrice d'une forme quadratique

Lorsque R est un corps de caractéristique différente de 2, on appelle matrice d'une forme quadratique la matrice de la forme bilinéaire symétrique dont est issue la forme quadratique.

Formule de changement de base

Soient E un R-module libre et B, C deux bases de E. Soit

une forme bilinéaire.

une forme bilinéaire.Notons

la matrice de f dans la base B et

la matrice de f dans la base B et  la matrice de f dans la base C. Notons

la matrice de f dans la base C. Notons  la matrice de passage. On a alors la formule de changement de base pour une forme bilinéaire (à ne pas confondre avec celle pour une application linéaire) :

la matrice de passage. On a alors la formule de changement de base pour une forme bilinéaire (à ne pas confondre avec celle pour une application linéaire) :Matrices congruentes

Article détaillé : Matrice congruente.Deux matrices carrées A et B sont dites congruentes s'il existe une matrice inversible P telle que

Deux matrices congruentes sont deux matrices qui représentent la même forme bilinéaire dans deux bases différentes.

Lorsque R est un corps de caractéristique différente de 2, toute matrice symétrique est congruente à une matrice diagonale. L'algorithme utilisé s'appelle réduction de Gauss à ne pas confondre avec le pivot de Gauss.

Matrices orthogonales

Article détaillé : Matrice orthogonale.Une matrice carrée A est dite orthogonale si

.

.

Des exemples de matrices orthogonales sont les matrices de rotation, comme la matrice de rotation plane d'angle θ

ou les matrices de permutation, comme

Matrices symétriques

Article détaillé : Matrice symétrique.Une matrice symétrique est une matrice qui est égale à sa propre transposée.

Exemple :

Matrices antisymétriques

Article détaillé : Matrice antisymétrique.Une matrice carrée A est dite antisymétrique si sa transposée est égale à son opposée ; c'est-à-dire si elle satisfait à l'équation : tA = -A.

Exemple :

Matrice d'une forme sesquilinéaire

Matrices hermitiennes

Une matrice A est dite hermitienne si elle est égale à la conjuguée de sa transposée; c'est-à-dire si elle satisfait l'égalité :

.

.

Exemple :

Matrices unitaires

Article détaillé : Matrice unitaire.Une matrice carrée A est dite unitaire si

.

.

Matrices quaternioniques

Article détaillé : Matrice quaternionique.Décomposition d'une matrice

On utilise abusivement le terme décomposition d'une matrice, qu'il s'agisse d'une véritable décomposition (en somme) comme dans la décomposition de Dunford ou d'une factorisation comme dans la plupart des autres décompositions.

Réduction d'une matrice carrée

Articles détaillés : Réduction d'endomorphisme, matrice diagonalisable, trigonalisation, polynôme d'endomorphisme et polynôme minimal d'un endomorphisme.- Réduire une matrice, c'est trouver une matrice qui lui est semblable la plus simple possible.

- Une matrice diagonalisable est une matrice semblable à une matrice diagonale : A est diagonalisable s'il existe une matrice inversible P et une matrice diagonale D telles que A = P − 1DP.

- Sur un corps algébriquement clos, on dispose de la réduction de Jordan qui est optimale et il existe des décompositions intermédiaires comme la décomposition de Dunford qui utilise les sous-espaces caractéristiques ou celle de Frobenius qui utilise les sous-espaces cycliques.

- Les polynômes d'endomorphismes jouent un rôle crucial dans les techniques de réduction.

Décomposition LU

Article détaillé : Décomposition LU.- C'est une factorisation en produit de deux matrices triangulaires.

- En lien avec le pivot de Gauss, c'est une méthode qui permet d'inverser une matrice.

Décomposition QR

Article détaillé : Décomposition QR.- C'est un résultat sur les matrices à coefficients réels ou à coefficients complexes.

- C'est une factorisation en produit d'une matrice orthogonale et d'une matrice triangulaire.

- C'est une traduction matricielle du procédé de Gram-Schmidt.

Décomposition polaire

Article détaillé : Décomposition polaire.- C'est un résultat sur les matrices à coefficients réels ou à coefficients complexes.

- C'est une factorisation en produit d'une matrice orthogonale et d'une matrice symétrique définie positive dans le cas réel, en produit d'une matrice unitaire et d'une matrice hermitienne définie positive dans le cas complexe.

- On peut décomposer à droite ou à gauche.

- On a unicité de la factorisation pour les matrices inversibles.

Normes et rayon spectral

Dans tout ce paragraphe, les matrices considérées sont dans

ou

ou  . De plus on identifie une matrice A avec l'endomorphisme de

. De plus on identifie une matrice A avec l'endomorphisme de  ou

ou  qui à la matrice colonne X associe la matrice colonne AX. Le cas réel et le cas complexe sont identiques.

qui à la matrice colonne X associe la matrice colonne AX. Le cas réel et le cas complexe sont identiques.Normes et normes d'algèbre

Article détaillé : Norme.Soit N une norme sur

ou

ou  .

.On dit que N est une norme d'algèbre (on dit aussi norme de Banach ou norme multiplicative) si

Certains auteurs imposent en outre que N(In) = 1.

Pour une norme quelconque, l'application bilinéaire

étant continue (on est en dimension finie), on est assuré de l'existence d'une constante k > 0 telle que

étant continue (on est en dimension finie), on est assuré de l'existence d'une constante k > 0 telle quePar suite, la norme kN est une norme d'algèbre. Toute norme sur

ou

ou  est donc proportionnelle à une norme d'algèbre.

est donc proportionnelle à une norme d'algèbre.Rayon spectral

Article détaillé : Rayon spectral.Soit A une matrice carrée à coefficients complexes. On appelle rayon spectral le plus grand module des valeurs propres de A. Dans tout ce qui suit, on notera ρ(A) le rayon spectral de A.

Théorème : Pour toute norme d'algèbre N sur

(respectivement dans

(respectivement dans  ) et pour toute matrice A dans

) et pour toute matrice A dans  (respectivement dans

(respectivement dans  ), l'inégalité suivante est vérifiée :

), l'inégalité suivante est vérifiée :Démonstration : Soit λ une valeur propre de A et X un vecteur propre associé. notons B la matrice carrée dont la première colonne est X et les autres sont nulles. On a AB = λB donc

et on peut simplifier par N(B) car le vecteur X étant non nul, il en est de même de la matrice B.

et on peut simplifier par N(B) car le vecteur X étant non nul, il en est de même de la matrice B.De plus, on montre que ρ(A) = inf N(A), la borne inférieure étant prise sur l'ensemble des normes subordonnées, donc a fortiori sur l'ensemble des normes d'algèbre.

Par contre, l'égalité peut s'avérer impossible. Il suffit pour cela de considérer une matrice non nulle dont le rayon spectral est nul :

Normes subordonnées

Articles détaillés : Norme subordonnée et Conditionnement (analyse numérique).Lorsqu'on munit

d'une norme

d'une norme  , on munit automatiquement

, on munit automatiquement  d'une norme, appelée norme subordonnée à

d'une norme, appelée norme subordonnée à  . Elle est donnée par la formule suivante donnée pour une matrice A quelconque dans

. Elle est donnée par la formule suivante donnée pour une matrice A quelconque dans  :

:

En notant

, on a

, on a- Si

, (norme infinie), alors la norme de A vaut :

, (norme infinie), alors la norme de A vaut :

- Si

, (norme indice 1), alors la norme de A vaut :

, (norme indice 1), alors la norme de A vaut :

Toute norme subordonnée est une norme d'algèbre avec en plus

.

.La réciproque, même avec cette clause supplémentaire

, est fausse. En effet, si N est subordonnée à

, est fausse. En effet, si N est subordonnée à  , avec

, avec  , il est nécessaire que, pour tout X, on ait

, il est nécessaire que, pour tout X, on ait  . C'est une conséquence immédiate du théorème de Hahn-Banach.

. C'est une conséquence immédiate du théorème de Hahn-Banach.À présent, si on pose

on vérifie toutes les propriétés attendues de N, mais le procédé précédent donne comme norme

la norme

la norme  classique, dont la norme subordonnée (cf. ci-dessus) n'est pas N.

classique, dont la norme subordonnée (cf. ci-dessus) n'est pas N.Norme subordonnée à la norme euclidienne

On se place dans la cas où

est muni de sa norme euclidienne canonique donnée par

est muni de sa norme euclidienne canonique donnée par  .

.Lorsque A est une matrice symétrique (respectivement hermitienne), la norme de A est égale au rayon spectral de A.

Dans le cas où A est une matrice quelconque, la norme de A est égal à

La norme de A est donc la plus grande des valeurs singulières de A (les valeurs singulières de A sont, par définition, les racines carrées des valeurs propres de

).

).Structure d'espace vectoriel euclidien

L'espace vectoriel

est canoniquement muni d'une structure euclidienne en voyant les éléments de Mm,n comme une collection de mn réels et en important la structure euclidienne de

est canoniquement muni d'une structure euclidienne en voyant les éléments de Mm,n comme une collection de mn réels et en important la structure euclidienne de  . Le produit scalaire s'écrit

. Le produit scalaire s'écrit

où

désigne la trace (i.e.,

désigne la trace (i.e.,  ) et les Aij (resp. Bij) désignent les éléments de A (resp. B). La norme associée à ce produit scalaire est la norme de Frobenius :

) et les Aij (resp. Bij) désignent les éléments de A (resp. B). La norme associée à ce produit scalaire est la norme de Frobenius :

Il ne s'agit pas d'une norme matricielle subordonnée à une norme vectorielle si n > 1, puisque

.

.Exponentielle d'une matrice

Article détaillé : Exponentielle d'une matrice.Soit

, Soit N une norme d'algèbre et

, Soit N une norme d'algèbre et  une série entière de rayon de convergence R.

une série entière de rayon de convergence R.Alors si N(A) < R, la série

est absolument convergente. (On le montre en utilisant que

est absolument convergente. (On le montre en utilisant que  .)

.)En particulier, on peut définir, pour toute matrice carrée complexe, la quantité

Le calcul effectif de cette exponentielle se fait par réduction de la matrice.

L'exponentielle joue un rôle central dans l'étude des systèmes linéaires d'équations différentielles.

Notes

- On peut remarquer que ce produit est donné par une formule analogue à celle donnant le produit scalaire usuel ; cette remarque sera exploitée plus loin

Voir aussi

Bibliographie

- J.M. Arnaudiès et H. Fraysse Cours de mathématiques, Dunod, 1980

- Bourbaki Algèbre I : Chapitres 1 à 3, CCLS, 1970.

- Bourbaki Algèbre I : Chapitres 1 à 3, Springer, 2006.

- Rached Mneimné, Réduction des endomorphismes, Calvage et Mounet, Paris, 2006 (ISBN 978-2-916352-01-5)

Liens externes

- Frédéric Brechenmacher, Les matrices : formes de représentation et pratiques opératoires (1850-1930)

Articles connexes

- Matrice de rotation

- Matrice de transition

- Comatrice

- Tenseur

- Représentation de groupe

- Paire de matrices commutantes

- Formule du binôme pour deux matrices qui commutent

Wikimedia Foundation. 2010.