- Theoreme de Cayley-Hamilton

-

Théorème de Cayley-Hamilton

Pour les articles homonymes, voir Hamilton.

Pour les articles homonymes, voir Hamilton.En algèbre linéaire, le théorème de Cayley-Hamilton (qui porte les noms des mathématiciens Arthur Cayley et William Hamilton) affirme que tout endomorphisme d'un espace vectoriel de dimension finie sur un corps quelconque annule son propre polynôme caractéristique.

En termes de matrice, cela signifie que :

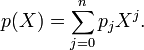

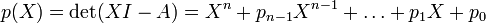

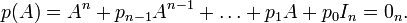

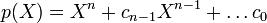

si A est une matrice carrée d'ordre n et si

est son polynôme caractéristique (polynôme d'indéterminée X), alors en remplaçant formellement X par la matrice A dans le polynôme, le résultat est la matrice nulle :

Le théorème de Cayley-Hamilton s'applique aussi à des matrices carrées à coefficients dans un anneau commutatif quelconque.

Un corollaire important du théorème de Cayley-Hamilton affirme que le polynôme minimal d'une matrice donnée est un diviseur de son polynôme caractéristique.

Sommaire

Motivation

Ce théorème possède deux familles d'utilisation:

- Il permet d'établir des résultats théoriques, par exemple pour calculer le polynôme caractéristique d'un endomorphisme nilpotent.

- Il autorise aussi des simplifications puissantes dans les calculs de matrices. L'approche par les polynômes minimaux est en général moins coûteuse que celle par les déterminants.

On trouve ce théorème utilisé dans les articles sur les polynômes d'endomorphisme, endomorphismes nilpotents, et plus généralement dans la théorie générale des matrices

Exemple

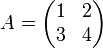

Considérons par exemple la matrice

.

.

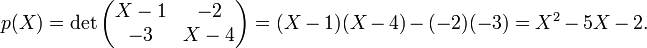

Le polynôme caractéristique s'écrit

Le théorème de Cayley-Hamilton affirme que

- A2 − 5A − 2I2 = 0

et cette relation peut être rapidement vérifiée dans ce cas. De plus le théorème de Cayley-Hamilton permet de calculer les puissances d'une matrice plus simplement que par un calcul direct. Reprenons la relation précédente

- A2 − 5A − 2I2 = 0

- A2 = 5A + 2I2

Ainsi, par exemple, pour calculer A4, nous pouvons écrire

- A3 = (5A + 2I2)A = 5A2 + 2A = 5(5A + 2I2) + 2A = 27A + 10I2

et il vient

- A4 = A3A = (27A + 10I2)A = 27A2 + 10A = 27(5A + 2I2) + 10A

- A4 = 145A + 54I2.

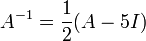

On peut également utiliser la relation polynomiale initiale A2 − 5A − 2I2 = 0 pour prouver l'inversibilité de A et calculer son inverse. Il suffit en effet de mettre en facteur une puissance de A là où c'est possible et

- A(A − 5I) = 2I2

ce qui montre que A admet pour inverse

Démonstration

Raisonnements faux

La plus grande difficulté de la démonstration du théorème de Cayley-Hamilton est qu'on peut se laisser piéger facilement par des raisonnements faux, et il importe de comprendre en quoi ces raisonnements sont faux, avant de tenter une démonstration correcte.

Dans la plupart des cas, ces erreurs proviennent de ce qu'on a appliqué un raisonnement valide dans un contexte commutatif au cas des matrices, dont l'arithmétique n'est pas commutative.

Un raisonnement naïvement faux

Le plus simple de tous les raisonnements faux est encore plus grossier : le polynôme caractéristique est défini par p(X) = det(XIn − A) ; si on substitue A à X, on devrait avoir p(A) = 0, ce qui n'a guère de sens. En effet, XIn est une matrice diagonale

, avec des X sur la diagonale. On peut imaginer une matrice diagonale par blocs, dont la diagonale serait formée de n blocs égaux à A. Bien sûr, cette matrice n'a pas la bonne taille pour qu'on puisse fabriquer sa différence avec A. On peut aussi imaginer de remplacer XIn par AIn = A, mais dans ce cas, le résultat det(A − A) est un scalaire nul, alors qu'on attendrait une matrice

, avec des X sur la diagonale. On peut imaginer une matrice diagonale par blocs, dont la diagonale serait formée de n blocs égaux à A. Bien sûr, cette matrice n'a pas la bonne taille pour qu'on puisse fabriquer sa différence avec A. On peut aussi imaginer de remplacer XIn par AIn = A, mais dans ce cas, le résultat det(A − A) est un scalaire nul, alors qu'on attendrait une matrice  nulle.

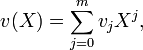

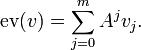

nulle.Il convient de remarquer que l'énoncé du théorème pourrait être troublant, puisqu'on prend un polynôme

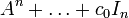

à coefficients scalaires, et qu'on substitue A à l'indéterminée X. Cette opération est définie sans ambiguïté : elle revient à remplacer Xj par Aj pour

à coefficients scalaires, et qu'on substitue A à l'indéterminée X. Cette opération est définie sans ambiguïté : elle revient à remplacer Xj par Aj pour  ; de plus, elle remplace le terme constant c0 par c0In et elle évalue la combinaison linéaire de matrices

; de plus, elle remplace le terme constant c0 par c0In et elle évalue la combinaison linéaire de matrices  dans l'espace vectoriel

dans l'espace vectoriel  des matrices carrées à coefficients dans

des matrices carrées à coefficients dans  . Dans un langage plus abstrait, on peut dire qu'il existe un unique homomorphisme d'anneau de

. Dans un langage plus abstrait, on peut dire qu'il existe un unique homomorphisme d'anneau de ![\mathbb{K}[X]](/pictures/frwiki/97/a54a58150f8fbfa21e4e47bea7551681.png) dans

dans  , qui envoie X sur A, et que p(A) est l'image de A par cet homomorphisme, dit homomorphisme d'évaluation.

, qui envoie X sur A, et que p(A) est l'image de A par cet homomorphisme, dit homomorphisme d'évaluation.Une idée correcte, mais qui finit mal

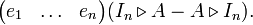

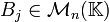

Un raisonnement plus compliqué, mais toujours faux, commence par le fait suivant, qui est d'ailleurs un ingrédient essentiel d'une preuve correcte : quelle que soit la matrice

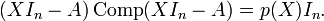

, il existe une matrice explicitement déterminée, Comp(S), la matrice complémentaire de S, qui vérifie SComp(S) = Comp(S)S = detSIn. La matrice Comp(S) est la transposée de la comatrice ou matrice des cofacteurs de S. Cette relation reste encore vraie si les coefficients de S appartiennent à un anneau, puisqu'on n'a pas fait de divisions. On peut donc poser S = XIn − A, dont les coefficients sont dans

, il existe une matrice explicitement déterminée, Comp(S), la matrice complémentaire de S, qui vérifie SComp(S) = Comp(S)S = detSIn. La matrice Comp(S) est la transposée de la comatrice ou matrice des cofacteurs de S. Cette relation reste encore vraie si les coefficients de S appartiennent à un anneau, puisqu'on n'a pas fait de divisions. On peut donc poser S = XIn − A, dont les coefficients sont dans ![\mathbb{K}[X]](/pictures/frwiki/97/a54a58150f8fbfa21e4e47bea7551681.png) et on a alors la relation:

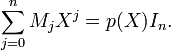

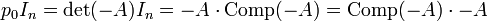

et on a alors la relation:- (XIn − A)Comp(XIn − A) = det(XIn − A)In = p(X)In.(1)

Une fois parvenu à cette relation correcte, on peut être tenté de substituer X par A et de conclure. Ce raisonnement est tout aussi faux que le précédent, puisqu'on a encore à donner un sens à AIn et à p(A)In.Un raisonnement plus sophistiqué, mais encore faux

On peut repartir de (1), en le voyant comme une identité entre polynômes de degré n en l'indéterminée X, et à coefficients matriciels, de la forme

(2)

(2)

La substitution devrait alors consister à remplacer MjXj par MjAj. ce qui est justifié. Mais le premier membre de (2) est un produit de polynômes P(X)Q(X), et s'il est correct dans l'anneau

![\mathcal{M}_n(\mathbb{K})[X]](/pictures/frwiki/49/1c75e1dfa516ba1ba75c9d6c4a2dd3e3.png) d'écrire PjXjQkXk = PjQkXj + k, cette relation est généralement fausse si on substitue X par A. Pour qu'elle soit correcte, il faudrait que Qk commute avec A, ce qui n'a pas de raison d'être vrai. Une manière plus abstraite de dire les choses est que, contrairement au cas scalaire, il n'y a pas d'homomorphisme d'évaluation envoyant

d'écrire PjXjQkXk = PjQkXj + k, cette relation est généralement fausse si on substitue X par A. Pour qu'elle soit correcte, il faudrait que Qk commute avec A, ce qui n'a pas de raison d'être vrai. Une manière plus abstraite de dire les choses est que, contrairement au cas scalaire, il n'y a pas d'homomorphisme d'évaluation envoyant ![\mathcal{M}_n(\mathbb{K})[X]](/pictures/frwiki/49/1c75e1dfa516ba1ba75c9d6c4a2dd3e3.png) sur

sur  en assignant A comme image de X, à moins que la matrice A appartienne au centre de

en assignant A comme image de X, à moins que la matrice A appartienne au centre de  , c'est à dire à l'ensemble des matrices scalaires.

, c'est à dire à l'ensemble des matrices scalaires.

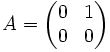

On peut préciser les choses sur un exemple concret. On considère la matrice ,

,

dont le polynôme caractéristique est p(X) = X2 ; la matrice complémentaire de XI2 − A est XI2 + A; l'équation (1) devient donc

- (XI2 − A)(XI2 + A) = X2I2.(3)

Bien sûr on peut substituer la matrice A à X dans cette identité, puisque le théorème de Cayley-Hamilton est vrai, et ce n'est pas ainsi qu'on pourrait réfuter la méthode proposée : la substitution dans l'identité (3) doit être correcte quelle que soit la matrice que l'on substitue. Si la méthode par substitution était correcte, on aurait (B − A)(B + A) = B2, ou encore, après simplification et en tenant compte de A2 = 0, BA − AB = 0. Cette relation devrait être vérifiée quelle que soit la matrice B, or il y a des matrices qui ne commutent pas avec A, par exemple sa transposée.

Aussi abstrait que faux

L'ensemble

![\mathbb{K}[X]^n](/pictures/frwiki/50/2ea14a1776b11982e1c8a4e176e185b3.png) des vecteurs colonne à coefficients polynômiaux est un module sur l'anneau

des vecteurs colonne à coefficients polynômiaux est un module sur l'anneau ![\mathbb{K}[X]](/pictures/frwiki/97/a54a58150f8fbfa21e4e47bea7551681.png) : si on multiplie un élément de

: si on multiplie un élément de ![\mathbb{K}[X]^n](/pictures/frwiki/50/2ea14a1776b11982e1c8a4e176e185b3.png) par un polynôme à coefficient dans

par un polynôme à coefficient dans  , on obtient encore un élément de

, on obtient encore un élément de ![\mathbb{K}[X]^n](/pictures/frwiki/50/2ea14a1776b11982e1c8a4e176e185b3.png) .

.La matrice A fournit un homomorphisme de

![\mathbb{K}[X]](/pictures/frwiki/97/a54a58150f8fbfa21e4e47bea7551681.png) dans l'anneau

dans l'anneau  , qui envoie X sur A ; c'est l'homomorphisme d'évaluation qu'on a déjà défini. Il y a également un homomorphisme d'évaluation de

, qui envoie X sur A ; c'est l'homomorphisme d'évaluation qu'on a déjà défini. Il y a également un homomorphisme d'évaluation de ![\mathbb{K}[X]^n](/pictures/frwiki/50/2ea14a1776b11982e1c8a4e176e185b3.png) dans

dans  : si

: si ![v\in \mathbb{K}[X]^n](/pictures/frwiki/102/f94b2da890e3c6980f7dff811104eaa0.png) est donné par

est donné paron pose

(4)

(4)

On multiplie l'identité (1) à droite par un vecteur arbitraire

, ce qui fournit

, ce qui fournit- (XIn − A)Comp(XIn − A)v = p(X)v,

qui est une identité dans . Il n'y a plus qu'à appliquer ev aux deux membres de la relation (4), et le tour est joué... sauf qu'on a encore cédé à la tentation de remplacer XIn par AIn, et qu'on a fait semblant de savoir que ev(M(X)N(X)v) = ev((MN)(X)v).

. Il n'y a plus qu'à appliquer ev aux deux membres de la relation (4), et le tour est joué... sauf qu'on a encore cédé à la tentation de remplacer XIn par AIn, et qu'on a fait semblant de savoir que ev(M(X)N(X)v) = ev((MN)(X)v).Le bout du tunnel

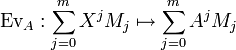

Enfin on peut accroître la confusion en définissant une autre application d'évaluation EvA de

![\mathcal{M}_n(\mathbb{K}[X])](/pictures/frwiki/51/3f7bc7ecbd12e5574d8ad6054b3b3d99.png) dans

dans

(5)

(5)

qui enverrait XIn − A sur la matrice nulle.

Le problème est que EvA n'est pas un homomorphisme d'anneaux (mais seulement une application K-linéaire), parce que EvA((XjM).(XkN)) n'est en général pas égal à EvA(Xj + kMN), toujours à cause de l'absence de commutativité dans les anneaux de matrices.

Mais dans notre cas, les coefficients du polynôme XIn − A commutent avec A, si bien que l'évaluation du produit est tout a fait justifiée, comme la suite de l'article va le montrer.

Une preuve

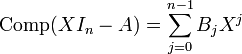

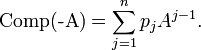

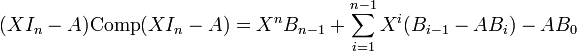

Toutes les tentatives de preuves sans effort ont échoué, donc il faut travailler pour de vrai quelque part. Partons de (1), en écrivant

avec

, et

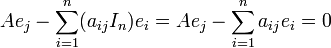

, etOn peut développer le produit (XIn − A)Comp(XIn − A) :

,(6)

,(6)

qui est identique à

(7)

(7)

Si on remplace dans le deuxième membre de (6) X par A, en laissant les A à gauche, on voit qu'on a une somme télescopique qui s'annule. La même substitution dans (7) fournit p(A), et maintenant, la démonstration est correcte.

Une variante

On peut également aligner des idées abstraites dans le même esprit que celles qui ont échoué dans la tentative « aussi abstraite que fausse » mais fournir une preuve juste.

Commençons par introduire un morphisme d'évaluation approprié à la résolution du problème. Tout d'abord,

![\mathbb{K}[A]](/pictures/frwiki/100/dd8ed67f088d3d54e206442208df1704.png) étant une algèbre commutative sur

étant une algèbre commutative sur  , on a un morphisme d'évaluation :

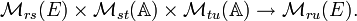

, on a un morphisme d'évaluation : ![\mathbb{K}[X] \to \mathbb{K}[A]](/pictures/frwiki/99/cd1fd81afb8fe40a01176310d6a92d38.png) (qui envoie X sur A et λ sur λIn pour tout scalaire λ). Ce morphisme d'anneaux commutatifs induit un morphisme d'évaluation sur les anneaux de matrices

(qui envoie X sur A et λ sur λIn pour tout scalaire λ). Ce morphisme d'anneaux commutatifs induit un morphisme d'évaluation sur les anneaux de matrices ![\mathcal{M}_n(\mathbb{K}[X]) \to \mathcal{M}_n(\mathbb{K}[A])](/pictures/frwiki/97/a8b6a24e6181b8e629c160788c40ae3a.png) .

.Une notation auxiliaire nous sera utile : pour deux matrices carrées (n,n) notées C = (cij) et D = (dij), on notera

la matrice à coefficients matriciels de terme général cijD. Si le lecteur connaît le produit de Kronecker de deux matrices, il pourra remarquer que

la matrice à coefficients matriciels de terme général cijD. Si le lecteur connaît le produit de Kronecker de deux matrices, il pourra remarquer que  c'est presque la même chose que

c'est presque la même chose que  à ceci près que

à ceci près que  est une matrice (n,n) dont les coefficients sont des matrices (n,n) tandis que

est une matrice (n,n) dont les coefficients sont des matrices (n,n) tandis que  est une matrice (n2,n2). Les formules ci-dessous ne contiennent de fait que deux cas particuliers de cette opération : des produits de la forme

est une matrice (n2,n2). Les formules ci-dessous ne contiennent de fait que deux cas particuliers de cette opération : des produits de la forme  c'est-à-dire des matrices carrées avec des C sur la diagonale et des 0 ailleurs et un produit

c'est-à-dire des matrices carrées avec des C sur la diagonale et des 0 ailleurs et un produit  c'est-à-dire une variante de A où la matrice aijIn vient remplacer le coefficient aij.

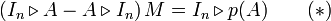

c'est-à-dire une variante de A où la matrice aijIn vient remplacer le coefficient aij.Cette notation posée, appliquons le morphisme d'évaluation à la relation :

On obtient une relation

dans laquelle M est une certaine matrice à coefficients dans

![\mathbb{K}[A]](/pictures/frwiki/100/dd8ed67f088d3d54e206442208df1704.png) dont on n'aura besoin de rien savoir.

dont on n'aura besoin de rien savoir.Ainsi on a écrit une formule juste, et on en pâtit : on n'a du coup pas fini, l'évaluation de XIn − A par une technique rigoureuse ne fournit pas 0 mais une bizarre matrice à coefficients matriciels.

Il faut une deuxième idée pour conclure. Elle consiste à remarquer que si

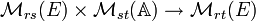

est un anneau et E un

est un anneau et E un  -module à droite, pour tous entiers r, s, t on peut définir par les formules habituelles un produit matriciel :

-module à droite, pour tous entiers r, s, t on peut définir par les formules habituelles un produit matriciel :pour laquelle on a associativité si on veut calculer des produits à trois termes :

Appliquons cette notion à

(pour les puristes à

(pour les puristes à  ) qui est un module (dont la multiplication s'écrit spontanément à gauche mais peut l'être à droite si on préfère, l'anneau étant commutatif) sur l'anneau commutatif

) qui est un module (dont la multiplication s'écrit spontanément à gauche mais peut l'être à droite si on préfère, l'anneau étant commutatif) sur l'anneau commutatif  , la multiplication externe étant l'application :

, la multiplication externe étant l'application :  définie par

définie par  (ce

(ce  étant le produit matriciel ordinaire de la matrice carrée

étant le produit matriciel ordinaire de la matrice carrée  par la matrice colonne

par la matrice colonne  ).

).Multiplions à gauche la relation ( * ) par le vecteur ligne

où

où  désigne la base canonique de

désigne la base canonique de  : en utilisant l'expression de droite dans ( * ) on obtient le vecteur ligne

: en utilisant l'expression de droite dans ( * ) on obtient le vecteur ligne  .

.Si maintenant on utilise l'expression de gauche dans ( * ) et qu'on déplace les parenthèses par associativité de la multiplication matricielle un peu inhabituelle décrite ci avant, on est amené à calculer le produit :

Pour chaque indice j, on ne peut que constater que sa j-ème composante vaut :

.

.

En multipliant ceci à droite par l'inoffensive matrice M et en comparant les deux expressions du produit, on conclut que pour tout indice j, p(A)ej = 0.

Et donc p(A) = 0[1].

Remarques additionnelles sur la démonstration

La preuve qui a été donnée évite la substitution de X par une matrice dans un contexte non commutatif, mais les manipulations effectuées sont quand même proches de cette idée : on a bien décomposé l'équation en composantes suivant les puissances de X, on a multiplié à gauche par Aj la composante qui était en facteur de Xj, et on a additionné tout ensemble. En fait, on a utilisé l'opération EvA définie en (5), sans supposer qu'il s'agisse d'un homomorphisme d'anneaux, de

![\mathcal{M}_n(\mathbb{K})[X]](/pictures/frwiki/49/1c75e1dfa516ba1ba75c9d6c4a2dd3e3.png) dans

dans  . L'opération EvA est une évaluation à gauche, parce que la multiplication par l'indéterminée scalaire X est remplacée par la multiplication à gauche par A.

. L'opération EvA est une évaluation à gauche, parce que la multiplication par l'indéterminée scalaire X est remplacée par la multiplication à gauche par A.

Une autre observation est importante : la forme exacte du polynôme Comp(XIn − A) n'a aucune importance. Il y a donc quelque chose à exploiter ici, ce que n'ont pas manqué de faire les mathématiciens.Soit M un anneau non commutatif ; on peut définir une division euclidienne d'un polynôme

![P\in M[X]](/pictures/frwiki/50/2f475431ef51dd5b6c7f4932a34d5f60.png) par un polynôme B monique. C'est un polynôme dont le coefficient du terme de plus haut degré est une unité de M, c'est à dire un élément de M qui possède un inverse dans M. Plus précisément, il existe deux polynômes

par un polynôme B monique. C'est un polynôme dont le coefficient du terme de plus haut degré est une unité de M, c'est à dire un élément de M qui possède un inverse dans M. Plus précisément, il existe deux polynômes ![Q, R\in M[X]](/pictures/frwiki/99/ca177aeefd0bdb387d55f236c6d9782e.png) , avec R de degré strictement inférieur au degré de B, tels que

, avec R de degré strictement inférieur au degré de B, tels que- P = BQ + R.

La démonstration est entièrement analogue à celle du cas scalaire. Si B = XIn − A, alors le reste R est de degré 0, et donc identique à une constante appartenant à M. Mais dans ce cas, en raisonnant exactement comme dans la démonstration du théorème de Cayley-Hamilton, on arrive à la conclusion

- EvA(P) = R.

Il s'ensuit que EvA(P) est nul si et seulement si P est divisible à gauche par XIn − A.

La démonstration du théorème de Cayley-Hamilton donne aussi une autre information : le polynôme Comp(XIn − A) est le quotient à gauche de p(X)In par tIn − A. Comme p(X)In et XIn − A appartiennent tous deux au sous-anneau commutatif K[A][X], la division à gauche se passe entièrement dans ce sous-anneau, c'est donc une division ordinaire. En particulier, les coefficients matriciels de Comp(XIn − A) sont des combinaisons linéaires de puissances de A. En d'autres termes, la matrice complémentaire d'une matrice A est un polynôme en A, ce qu'il n'est pas facile de déduire directement de la définition d'une matrice complémentaire. Mieux, on peut calculer explicitement ses coefficients à partir de ceux du polynôme caractéristique p(X), puisqu'il s'agit de faire une division euclidienne ordinaire, et on trouve

On aurait pu également obtenir cette relation directement à partir du théorème de Cayley-Hamilton, en vertu de l'identité

.

.

Abstraction et généralisations

La preuve donnée ci-dessus n'utilise que les propriétés d'anneau commutatif du corps

. La règle de Cramer reste valide pour une matrice à coefficients dans n'importe quel anneau commutatif B. On peut donc généraliser le théorème de Cayley-Hamilton à ce cas, en utilisant la règle de Cramer pour des matrices à coefficients dans l'anneau B = R[X], R étant un anneau commutatif quelconque.

. La règle de Cramer reste valide pour une matrice à coefficients dans n'importe quel anneau commutatif B. On peut donc généraliser le théorème de Cayley-Hamilton à ce cas, en utilisant la règle de Cramer pour des matrices à coefficients dans l'anneau B = R[X], R étant un anneau commutatif quelconque.

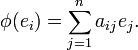

Dans un cadre encore plus abstrait, si M est un module libre de type fini sur un anneau commutatif R, le théorèmde de Cayley-Hamilton continue à fonctionner. Mieux, si φ est un endomorphisme d'un R-module M de de type fini, on peut définir le polynôme caractéristique de φ comme suit : soient une famille de générateurs de M. On peut trouver des éléments aij de R tels que

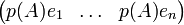

une famille de générateurs de M. On peut trouver des éléments aij de R tels queLes coefficients aij ne sont pas uniquement déterminés, puisqu'on n'a pas supposé libre la famille des ei. Néanmoins, si on note A la matrice

formée de ces coefficients, on peut montrer que le polynôme p(X) = det(XIn − A) ne dépend pas du choix des aij, mais seulement de l'endomorphisme φ. De même, on peut définir la matrice complémentaire de l'endomorphisme φ et établir une version généralisée de la règle de Cramer.

formée de ces coefficients, on peut montrer que le polynôme p(X) = det(XIn − A) ne dépend pas du choix des aij, mais seulement de l'endomorphisme φ. De même, on peut définir la matrice complémentaire de l'endomorphisme φ et établir une version généralisée de la règle de Cramer.Dans ce cas, le théorème de Cayley-Hamilton est toujours vrai, et la conclusion est p(φ) = 0. La preuve donnée plus haut continue à fonctionner, puisqu'elle ne comporte pas de division par des éléments de

, et donc dans le cas présent de division par des éléments de R. Cette version plus générale est la source du célèbre lemme de Nakayama en géométrie algébrique.

, et donc dans le cas présent de division par des éléments de R. Cette version plus générale est la source du célèbre lemme de Nakayama en géométrie algébrique.Références

- (en) Cet article est partiellement ou en totalité issu d’une traduction de l’article de Wikipédia en anglais intitulé « Cayley-Hamilton Theorem ».

- ↑ Cette preuve est celle qui figure dans Introduction to commutative algebra, M. F. Atiyah et I. G. Macdonald, Addison-Wesley, (ISBN 0-201-00361-9), p. 21.

Voir aussi

- Portail des mathématiques

Catégories : Application linéaire | Polynôme | Théorème de mathématiques

Wikimedia Foundation. 2010.