- Loi Binomiale

-

Loi binomiale

Binomiale Densité de probabilité / Fonction de masse

Fonction de répartition

Paramètres  nombre d'épreuves (entier)

nombre d'épreuves (entier)

probabilité de succès (réel)

probabilité de succès (réel)

q = 1 − pSupport

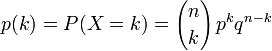

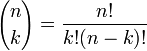

Densité de probabilité (fonction de masse)

Fonction de répartition

Espérance

Médiane (centre) un des  [1]

[1]Mode

Variance

Asymétrie (statistique)

Kurtosis (non-normalisé)

Entropie

Fonction génératrice des moments

Fonction caractéristique

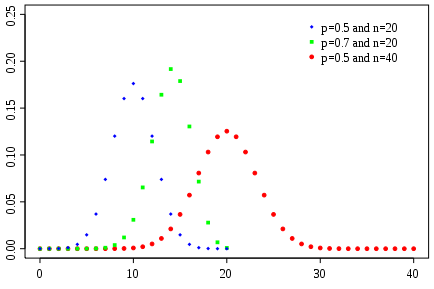

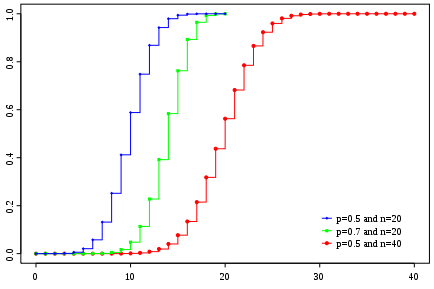

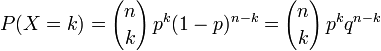

En mathématiques, une loi binomiale de paramètres n et p est une loi de probabilité qui correspond à l'expérience suivante :

On renouvelle n fois de manière indépendante une épreuve de Bernoulli de paramètre p (expérience aléatoire à deux issues possibles, généralement dénommées respectivement « succès » et « échec », la probabilité d'un succès étant p, celle d'un échec étant q = (1 − p)). On compte alors le nombre de succès obtenus à l'issue des n épreuves et on appelle X la variable aléatoire correspondant à ce nombre de succès.

L'univers

désigne l'ensemble des entiers naturels de 0 à n.

désigne l'ensemble des entiers naturels de 0 à n.La variable aléatoire suit une loi de probabilité définie par :

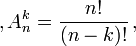

Cette formule fait intervenir le nombre des combinaisons de k éléments parmi n qui se note désormais

même si la notation

même si la notation  a été longtemps utilisée mais n'est plus reconnue. Notons que ce nombre de combinaisons se distingue du nombre des arrangements de k éléments parmi n

a été longtemps utilisée mais n'est plus reconnue. Notons que ce nombre de combinaisons se distingue du nombre des arrangements de k éléments parmi n  du fait que dans une combinaison l'ordre des éléments n'importe pas. Et comme il y a k! (prononcer factorielle k) façons d'ordonner k éléments, le nombre des combinaisons se déduit du nombre des arrangements par la simple division

du fait que dans une combinaison l'ordre des éléments n'importe pas. Et comme il y a k! (prononcer factorielle k) façons d'ordonner k éléments, le nombre des combinaisons se déduit du nombre des arrangements par la simple division  et on obtient :

et on obtient :Cette loi de probabilité s'appelle la loi binomiale de paramètre (n ; p) et se note B(n ; p).

Sommaire

Calcul de p(k)

Une épreuve de Bernoulli conduit à la création d'un univers Ω = {S ; E}, (S pour Succès et E pour Echec).

n épreuves de Bernoulli indépendantes conduisent à la création d'un univers Ωn constitué de n-uplets d'éléments de Ω, sur lequel peut se définir une probabilité produit. La probabilité de l'éventualité (S, S, ..., S, E, E, ..., E) avec k succès et n - k échecs a donc pour valeur pkqn-k.

Plus généralement, tout n-uplet formé de k succès et de n-k échecs aura pour probabilité pkqn-k quel que soit l'ordre d'apparition des S et des E.

L'évènement « X = k » est formé de tous les n-uplets comportant k succès et n - k échecs. La combinatoire permet de déterminer le nombre de n-uplets de ce type : il y en a autant que de parties à k éléments d'un ensemble à n éléments ; or chaque partie correspond à une façon de placer les k succès parmi les n places du n-uplet. Il y a donc

n-uplets, chacun ayant une probabilité égale à pkqn-k.

n-uplets, chacun ayant une probabilité égale à pkqn-k.Donc

.

.Espérance, variance, écart type

X est la somme de n variables aléatoires indépendantes suivant toutes la (même) loi de Bernoulli de paramètre p, prenant la valeur 1 en cas de succès (probabilité p) et 0 en cas d'échec (probabilité (1-p)) ; ces variables aléatoires ont pour espérance p et pour variance p(1-p).

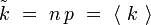

- E(X) est donc la somme des espérances, soit np

- V(X) est la somme des variances, soit np(1-p)

Convergence

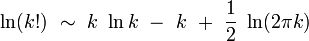

Pour de grandes valeurs de n, le calcul de

devient vite pratiquement impossible, sauf si l'on cherche à calculer le logarithme de cette expression au lieu de l'expression elle-même (et à condition d'utiliser l'approximation des factorielles par la formule de Stirling). On distingue deux cas :

devient vite pratiquement impossible, sauf si l'on cherche à calculer le logarithme de cette expression au lieu de l'expression elle-même (et à condition d'utiliser l'approximation des factorielles par la formule de Stirling). On distingue deux cas :- Lorsque n tend vers l'infini et que p tend vers 0 avec np = a, la loi binomiale converge vers une loi de Poisson de paramètre a. En pratique, on remplace la loi binomiale par une loi de Poisson dès que n > 30 et np < 5 ou dès que n > 50 et p < 0.1.

- Lorsque n tend vers l'infini et que p et q sont de même ordre de grandeur, la loi binomiale converge vers une loi normale d'espérance np et de variance npq. En pratique, on remplace une loi binomiale par une loi normale dès que n > 30, np > 5 et nq > 5

Démonstration de la convergence vers la loi normaleSupposons que p(k) admette un extremum pour

. Alors, lnp(k) admet un extremum

. Alors, lnp(k) admet un extremum  , car la fonction logarithme est monotone croissante. On calcule lnp(k) à l'aide de la formule de Stirling :

, car la fonction logarithme est monotone croissante. On calcule lnp(k) à l'aide de la formule de Stirling :

Il vient :

![\ln p(k) \ \sim \ n \ \ln n \ - \ n \ + \ \frac{1}{2} \ \ln ( 2 \pi n) \ - \ \left[ \ k \ \ln k \ - \ k \ + \ \frac{1}{2} \ \ln ( 2 \pi k) \ \right]](/pictures/frwiki/57/947c75fb3fc52ebe75676aab0ef2ce81.png)

![\ - \ \left[ \ (n-k) \ \ln (n-k) \ - \ (n-k) \ + \ \frac{1}{2} \ \ln ( 2 \pi (n-k) \, ) \, \right] \ + \ k \ln p \ - \ (n-k) \ln (1-p)](/pictures/frwiki/101/edad49e47e13c7dc60017381401422b3.png)

La dérivée par rapport à k donne :

![\frac{d~}{dk} \ln p(k) \ \sim \ \ln \left[ \, \frac{(n-k) \ p}{k \ (1 - p)} \, \right] \ + \ O \left( \frac{1}{k} \right)](/pictures/frwiki/54/654ed8bcdeb5544d4f033529dc1ea92a.png)

Pour annuler cette dérivée, il faut que l'argument du logarithme soit égal à un. On obtient alors la valeur de k qui rend le logarithme extremum :

La valeur la plus probable est donc la valeur moyenne. La dérivée seconde vaut par ailleurs :

![\frac{d^2~}{dk^2} \ln p(k) \ \sim \ - \ \left[ \, \frac{1}{n-k} \ + \ \frac{1}{k} \, \right] \ + \ O \left( \frac{1}{k^2} \right)](/pictures/frwiki/101/e00678b5c870f04ecc2697d6e35730c4.png)

Calculée en

, elle vaut :

, elle vaut :![\frac{d^2~}{dk^2} \ln p(\tilde{k}) \ \sim \ - \ \left[ \, \frac{1}{np(1-p)} \, \right] \ = \ - \ \frac{1}{\sigma^2}](/pictures/frwiki/100/d219dc5afa044a884df04dea3bf2add8.png)

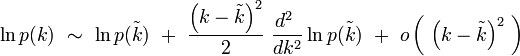

On peut donc écrire le développement limité au second ordre suivant :

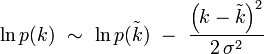

qui s'écrit compte-tenu de ce qui précède :

soit en prenant l'exponentielle :

![p(k) \ \sim \ p(\tilde{k}) \ \exp \ \left[ - \ \frac{\left( k - \tilde{k} \right)^2}{2 \, \sigma^2} \ \right]](/pictures/frwiki/100/d2d4b67d617bc558f50c4e8cfefa8c03.png)

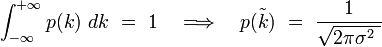

On détermine la constante

avec la condition de normalisation des probabilités totales :

avec la condition de normalisation des probabilités totales :

d'où la distribution gaussienne :

![p(k) \ = \ \frac{1}{\sqrt{2 \pi \sigma^2 \ }} \ \exp \ \left[ - \ \frac{\left( k - \langle \ k \ \rangle \, \right)^2}{2 \, \sigma^2} \ \right]](/pictures/frwiki/97/af25d49973129a7512ec90450721f597.png)

Loi des grands nombres

La loi binomiale, son espérance et sa variance, ainsi que l'inégalité de Bienaymé-Tchebychev permettent de démontrer une version simple de la loi des grands nombres.

Références

- ↑ Hamza, K. (1995). The smallest uniform upper bound on the distance between the mean and the median of the binomial and Poisson distributions. Statist. Probab. Lett. 23 21–25.

Voir aussi

- Loi multinomiale

- Loi de probabilité

- Probabilité

- Probabilité (mathématiques élémentaires)

- Variables aléatoires élémentaires

- Marche aléatoire

Lien externe

- Portail des probabilités et des statistiques

Catégorie : Loi de probabilité

Wikimedia Foundation. 2010.